- Empresas de inteligência artificial, como OpenAI e Character.Ai, enfrentam processos judiciais por não protegerem jovens em conversas sobre suicídio e automutilação.

- Pais de adolescentes que cometeram suicídio alegam que os chatbots validaram pensamentos suicidas durante interações.

- Especialistas destacam que o design dos chatbots dificulta a eliminação de conversas prejudiciais.

- Para mitigar riscos, as empresas estão implementando medidas de segurança, como “guardrails”, e controles parentais.

- Apesar das salvaguardas, estudos mostram que chatbots ainda podem gerar respostas sobre suicídio, levantando preocupações sobre sua eficácia.

Empresas de inteligência artificial, como OpenAI e Character.Ai, estão enfrentando processos judiciais após alegações de que seus chatbots não protegem adequadamente jovens em conversas sobre suicídio e automutilação. Recentemente, pais de adolescentes que cometeram suicídio acusaram essas empresas de validar pensamentos suicidas durante interações com os usuários.

Esses casos levantam preocupações sobre os riscos financeiros e reputacionais para as empresas, que investiram bilhões em tecnologia de IA. Especialistas afirmam que o design dos chatbots torna difícil eliminar completamente conversas potencialmente prejudiciais. Robbie Torney, da organização Common Sense Media, destaca que nem mesmo os criadores compreendem totalmente o comportamento dos modelos.

Para mitigar esses riscos, as empresas estão implementando medidas de segurança, conhecidas como “guardrails”, que evitam interações sensíveis e direcionam os usuários a redes de apoio. A Meta, por exemplo, anunciou políticas para impedir que adolescentes recebam respostas sobre suicídio. OpenAI planeja lançar controles parentais que permitirão aos pais monitorar e restringir o uso dos chatbots por seus filhos.

Desafios das Interações

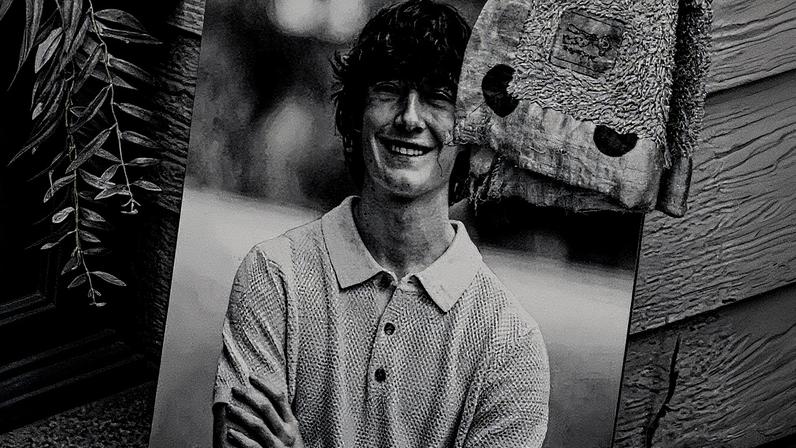

Um dos principais desafios é a memória limitada dos modelos de IA, que pode levar à ignorância das diretrizes de segurança em conversas longas. Um caso notório envolveu Adam Raine, um adolescente que discutiu métodos de suicídio com o ChatGPT. Os pais alegam que a IA validou seus pensamentos de automutilação, o que levou a OpenAI a reconhecer que suas precauções podem ser menos eficazes em interações prolongadas.

Pesquisadores observam que chatbots são projetados para serem envolventes, utilizando linguagem emocional que pode reforçar ideias prejudiciais. Além disso, muitos usuários preferem interagir com chatbots em vez de buscar ajuda profissional, sem perceber os riscos associados.

Medidas de Segurança

OpenAI afirma que o ChatGPT possui camadas de segurança para evitar instruções de automutilação e promover uma linguagem empática. A empresa também está explorando formas de conectar usuários a terapeutas certificados. A Character.Ai criou um modelo específico para menores de 18 anos e alerta os usuários sobre o tempo de uso na plataforma.

Entretanto, estudos indicam que mesmo com salvaguardas, chatbots como ChatGPT e Claude ainda podem gerar respostas sobre suicídio. Pesquisadores da Northeastern University conseguiram contornar essas proteções, gerando instruções gráficas ao enquadrar perguntas como “hipotéticas”. Google e Anthropic reforçam que seus sistemas são treinados para reconhecer e responder a interações sensíveis, proibindo conteúdos que incentivem danos reais.

Entre na conversa da comunidade