- Nos últimos três anos, a inteligência artificial (IA) se tornou essencial em diversas áreas, como saúde, educação e entretenimento.

- Uma pesquisa de 2024, realizada pelo Google e Ipsos, mostrou que cinquenta e quatro por cento dos brasileiros utilizam ferramentas de IA generativa, superando a média mundial.

- Especialistas alertam que os impactos da IA vão além da conveniência, afetando o desenvolvimento cognitivo e social de crianças e adolescentes.

- Casos extremos, como processos contra plataformas de IA por estimular ideias suicidas, levantam preocupações sobre o uso seguro dessas tecnologias.

- No Brasil, a desigualdade de acesso à tecnologia entre escolas públicas e privadas é um desafio, e a falta de regulamentação específica para IA aplicada a menores gera lacunas na proteção desses jovens.

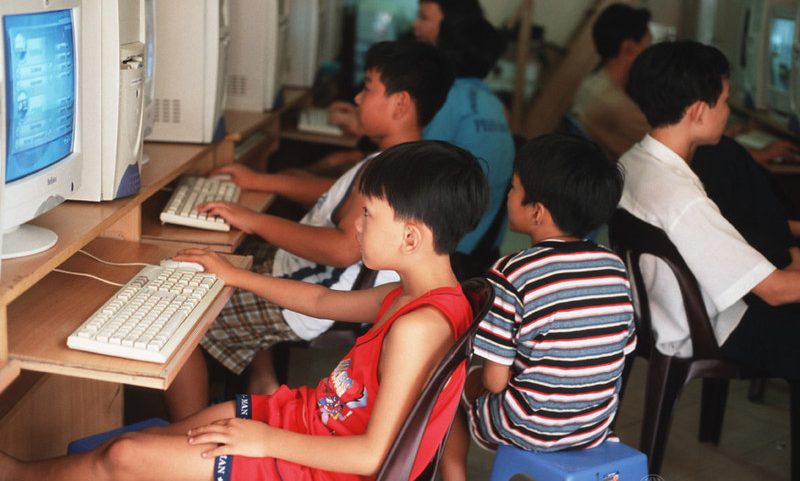

Nos últimos três anos, a inteligência artificial deixou de ser apenas promessa para se tornar protagonista em áreas que vão da saúde ao entretenimento, passando pela educação, jornalismo e até pela vida doméstica. Como ocorreu com a chegada do celular ou a explosão das redes sociais, a sociedade se volta para a mesma pergunta: qual o impacto dessas ferramentas sobre as futuras gerações?

No caso da IA, a questão é ainda mais urgente: crianças e adolescentes não apenas consomem a tecnologia, mas crescem imersos nela. Uma pesquisa global realizada em 2024 pelo Google em parceria com a Ipsos revelou que o Brasil está acima da média mundial no uso de ferramentas de inteligência artificial generativa. 54% dos brasileiros declararam ter utilizado esse tipo de recurso, reflexo tanto do perfil digitalmente conectado da população quanto da rápida adoção de novas tecnologias no país.

Especialistas da psicologia e da educação já identificam um ponto comum: os efeitos vão muito além da comodidade ou da produtividade. Estão em jogo dimensões centrais do desenvolvimento cognitivo, do comportamento social, da relação com a aprendizagem e da formação do pensamento crítico. Para entender melhor esse cenário, o Portal Tela ouviu profissionais dessas duas áreas, que analisam tanto os riscos quanto as possibilidades abertas pela IA na vida de crianças e adolescentes.

O chatbot não é seu amigo

O debate sobre inteligência artificial e juventude ganha contornos dramáticos quando se observam os casos mais extremos. Nos últimos meses, famílias de adolescentes entraram com processos contra plataformas como ChatGPT e [Character.AI](http://Character.AI), alegando que os sistemas contribuíram para estimular ideias suicidas. Em uma das ações mais recentes, a ferramenta teria validado pensamentos autodestrutivos de um jovem norte-americano, que pouco depois tirou a própria vida.

Diante de casos como esse, especialistas alertam para a necessidade de análise cuidadosa, sem dramatizações nem negligência.

Para a psicóloga clínica Cristina Barros, que atua com crianças e adolescentes, é preciso cautela ao relacionar diretamente a IA ao aumento de comportamentos de risco. *”O número de casos de autolesão e suicídio entre jovens vem crescendo, mas não dá para isolar a inteligência artificial como causa única. Esses adolescentes já buscavam conteúdos nocivos nas redes antes mesmo da popularização dos chats. A preocupação é válida, mas precisamos evitar o pânico moral”*, afirma.

Já Marina Abud, psicóloga formada pela Universidade de São Paulo (USP) e especialista no impacto psíquico da hiperconectividade, chama atenção para um aspecto central do desenvolvimento adolescente: a constituição da identidade. *”A adolescência é um momento em que o olhar do outro é fundamental. Quando um chatbot se apresenta como se fosse um amigo, pode funcionar como um espelho simplista que reforça angústias e fragiliza a capacidade de construir vínculos reais. O risco é enfraquecer a alteridade e a empatia”*, explica.

O desafio de aprender e ensina**r**

Se nas redes sociais e na saúde mental os impactos da inteligência artificial já preocupam, na educação o cenário não é diferente.

Para a professora e articuladora pedagógica Cláudia Cely, que atua tanto na rede pública quanto na privada, não há espaço para negar a realidade. *”A IA é um fato. Cabe ao professor mediar seu uso, entender os limites e potencializar o que ela pode oferecer de produtivo em sala de aula”.* Segundo ela, insistir na discussão sobre se a tecnologia é boa ou ruim já não faz sentido; a questão é como integrá-la de forma crítica ao processo educativo.

Os desafios, no entanto, são consideráveis. É preciso garantir formação docente, infraestrutura tecnológica adequada e um olhar atento para os dilemas éticos, como a autoria e a originalidade dos trabalhos. Sem essa mediação, o risco é que a IA fragilize o desenvolvimento do pensamento crítico, ofereça respostas prontas e desestimule a resolução de problemas complexos — habilidades essenciais para a vida adulta.

Ainda assim, educadores reconhecem potenciais positivos. Entre eles, a personalização da aprendizagem, já que os algoritmos permitem mapear o perfil de cada estudante e oferecer conteúdos adaptados às suas necessidades. A IA também pode ajudar a ressignificar o papel do professor, que deixa de ser apenas transmissor de informação e passa a atuar como mediador, orientando os alunos a transformar dados em conhecimento.

Acesso e desigualdade

Outro ponto central do debate é a desigualdade de acesso. No Brasil, as diferenças entre escolas públicas e privadas marcam também a forma como crianças e adolescentes entram em contato com a inteligência artificial.

*”É um mito achar que estudantes da rede pública não têm acesso à tecnologia. Eles têm, ainda que de forma desigual. Na Bahia, por exemplo, já há distribuição de tablets e Chromebooks, além de iniciativas de educação digital e midiática. O problema é que a infraestrutura muitas vezes é precária: internet lenta, equipamentos insuficientes e falta de formação adequada para professores”*, alerta Cláudia sobre alguns equívocos na percepção pública.

Esse cenário contrasta com escolas particulares, onde os recursos costumam ser mais abundantes, mas ainda assim dependem da política de cada instituição. Essa diferença se soma a outro fator recente: a Lei nº 15.100/2025, que proibiu o uso de celulares em sala de aula. A medida, voltada à proteção de crianças e adolescentes contra distrações e riscos digitais, também abriu espaço para questionamentos sobre o equilíbrio entre segurança e inovação pedagógica, incluindo o uso educativo de ferramentas de IA acessíveis via dispositivos móveis.

As regras do jogo ainda não existem

Nos Estados Unidos, um projeto chamado *Leading Ethical AI Development for Kids Act* avança no Congresso com a proposta de criar regras específicas para sistemas voltados a menores de idade. No centro da discussão está a pergunta: até que ponto as big techs são responsáveis pelos impactos que suas ferramentas causam em adolescentes vulneráveis?

Cristina defende que os desenvolvedores precisam considerar seriamente os efeitos que suas plataformas podem ter em jovens, principalmente aqueles em sofrimento psíquico. *”É essencial que os sistemas sejam programados para não fornecer informações que potencializem comportamentos autodestrutivos. Pelo contrário, podem até servir como alerta, se bem orientados”*, afirma.

No Brasil, o debate ainda engatinha. Não existe uma legislação específica para inteligência artificial aplicada a menores. Casos de exploração digital ou de uso de deepfakes com adolescentes têm sido enquadrados em dispositivos já existentes, como o artigo 216-B do Código Penal, que criminaliza a produção e a divulgação de conteúdo íntimo sem consentimento. Especialistas apontam, no entanto, que a ausência de uma regulação própria deixa lacunas perigosas em um cenário de rápida expansão tecnológica.

O futuro já chegou

O desafio que se coloca para a sociedade é equilibrar riscos e oportunidades, sem cair na ingenuidade nem no pânico moral.

Os benefícios já se fazem notar: jovens utilizam IA para explorar a criatividade, compondo músicas, criando imagens e até desenvolvendo códigos. Na educação, a tecnologia tem se mostrado uma aliada para a inclusão, especialmente em iniciativas de Atendimento Educacional Especializado (AEE) e nos processos de alfabetização.

Mas a responsabilidade não recai sobre uma única instância. O papel é compartilhado entre escola, família, profissionais de saúde e desenvolvedores de tecnologia. Como lembra a psicóloga Marina Abud, os adultos também são impactados pelas transformações digitais, o que torna a mediação uma responsabilidade coletiva.

A questão, no fim, não é se devemos ou não conviver com a inteligência artificial, mas como preparar as próximas gerações para usá-la de forma crítica, ética e produtiva. Esse é um dos grandes desafios educacionais e sociais do nosso tempo, e a resposta está sendo construída agora por todos nós.

Entre na conversa da comunidade