- Pesquisadores usam lasers ultrarrápidos para gravar dados em vidro, criando estruturas nanométricas em cinco dimensões para armazenamento de alta densidade e possível “memória eterna”.

- A leitura acontece com microscópio óptico especial que detecta mudanças na polarização da luz; velocidade de leitura atual é de cerca de 30 MB por segundo, com meta de 500 MB por segundo em três a cinco anos.

- A demanda global por dados cresce rapidamente, com estimativa de 394 zettabytes por ano até 2028; data centers respondem por cerca de 1,5% da eletricidade mundial e devem dobrar até 2030, aumentando emissões.

- A Microsoft tem investido no armazenamento em vidro borossilicato (mais barato que o vidro tradicional) com promessa de durar até 10 mil anos, embora ainda não esteja comercializado.

- Observadores ressaltam que, apesar de parecer promissora, memória cristal e armazenamento em DNA devem coexistir com tecnologias atuais, enquanto melhorias de eficiência de infraestrutura, hardware e software são apontadas como passos práticos para diminuir o consumo de energia.

A artech curou a busca por armazenagem de dados diante do crescimento explosivo do consumo de energia nos data centers. Pesquisadores avaliam soluções que vão além dos cabos e torres de refrigeração, entre elas cristais de vidro gravados com laser e armazenamento em DNA. O objetivo é reduzir emissões e ampliar a durabilidade dos dados.

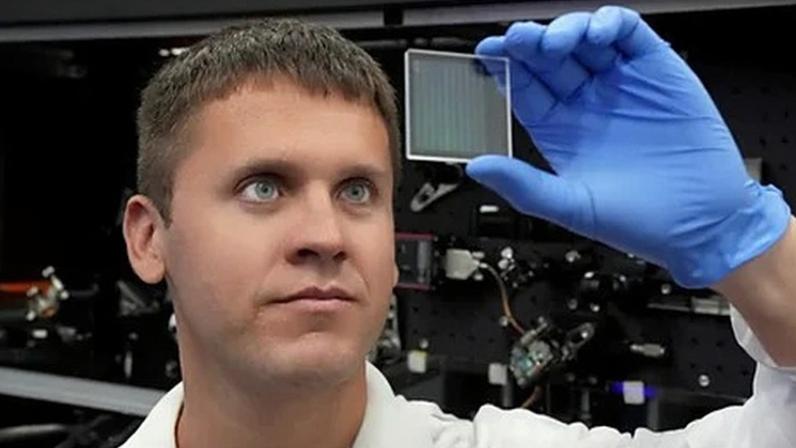

A ideia de Kazansky começou em Kyoto, no Japão, durante experimentos com lasers ultrarrápidos que gravam padrões dentro do vidro. Ao observar padrões de dispersão da luz, ele percebeu que era possível imprimir informações em três dimensões, dentro de materiais transparentes, em escala menor que o comprimento de onda da luz.

Esses padrões criam estruturas nanométricas ocultas na sílica, gerando chamadas “vórtices” de luz. Com leitura por microscópio óptico adaptado, é possível decodificar os dados a partir da intensidade e da polarização da luz. O avanço viabiliza armazenamento potencialmente de dados em altas densidades.

Nessas pesquisações, o método de Kazansky permite codificar dados em cinco dimensões, combinando orientação, intensidade e localização de voxels. A promessa é de armazenamento em grandes volumes num espaço muito reduzido e, em teoria, de duração quase eterna. A empresa SPhotonix atua desde 2024 para levar a tecnologia ao mercado.

Apesar do otimismo, especialistas apontam entraves práticos. A compatibilidade com infraestruturas atuais é um obstáculo significativo para adoção ampla. Avalia-se ainda se a velocidade de leitura e escrita será competitiva frente a soluções existentes no curto prazo.

DNA data

A ideia de guardar informações no DNA é mais antiga e ainda é estudada como alternativa eficiente e estável. Um grama de DNA poderia armazenar volumes extraordinários por milhares de anos, segundo pesquisadores, com leitura relativamente estável ao longo do tempo.

A tradução de dados binários para bases nucleotídicas é simples na teoria: mapear 0s e 1s nas letras A, T, C e G, sintetizar a molécula correspondente e conservar.

Contudo, o custo de escrita continua sendo o principal desafio, ainda mais para grandes volumes. Leitura de DNA avança mais rapidamente, o que alimenta a aposta de que, no longo prazo, o DNA pode complementar ou substituir métodos tradicionais em tarefas de arquivamento.

Microsoft tem peso destacado nesse cenário, financiando pesquisas e já demonstrando armazenamento de dados em DNA no passado. Em 2026, a empresa divulgou avanços envolvendo vidro borossilicato, que tende a reduzir custos e ampliar a durabilidade da mídia. No momento, porém, não se trata de produção comercial.

Rumo a uma nova lógica de computação

Especialistas ressaltam que soluções como vidro e DNA são atrativas pela sustentabilidade, mas não devem substituir o armazenamento convencional no curto prazo. Melhorias na eficiência de infraestrutura, com processadores mais econômicos e técnicas de resfriamento avançadas, aparecem como caminhos práticos para reduzir consumo de energia imediato.

Também ganha relevância a gestão de software e cargas de trabalho. Algoritmos e aplicações precisam ser projetados com foco na eficiência energética, adequando o uso de recursos à tarefa, evitando modelos excessivamente pesados para problemas simples.

Enquanto o aumento de dados persiste, especialistas questionam a necessidade de conservar tudo. A seleção criteriosa do que manter pode ser parte da solução para reduzir a demanda futura por armazenamento.

Entre na conversa da comunidade